※ 引述《ykjiang (York)》之銘言:

: 從最基本的原理來說,光達跟雷達就是用來測距,理論上只有一維的資訊

: 三維的部分是經過一些設計、運算後得到的

: 反而鏡頭得到的一開始就是二維資訊,然後可以經過運算得到三維的資訊,

這邊看完,我的感想只有“供三小?”

雷達與光達在原理上是利用掃描的方式,取得距離與向量,本質上資料的維度就是大於二維了。

是什麼時候變一維的?如果要這麼瞎扯,那鏡頭裡的CMOS一次也只能讀一個cell的資料,

一樣得要逐個掃描才能得到二維影像(這個就是所謂的果凍效應的成因),

照你的說法,鏡頭不也一樣是一維的?

: 特斯拉更進一步從中取得四維資訊(多的那維是時間軌跡預測)

這邊也不知道在供三小

在半個世紀前,雷達後處理技術就已經發展出利用比對前後時間目標的變化,預測目標未來位置,

並且持續追蹤的技術。甚至還有類似合成孔徑雷達(SAR)那種利用時間與位移積分,

利用二維掃描形成3維雷達影像的技術。

而利用都卜勒濾波技術,甚至不需要比對前後時間的資料,就能直接得到目標的速度,

在半個世紀前,雷達就能直接利用都卜勒測速,外插推估目標的未來位置。

但也沒人講雷達是四維資料的探測器。

而特斯拉的前鏡頭並沒有構成立體視覺,就算加上時間預測,也只能構成2.5D,

(三個定焦鏡只能利用影像模糊的程度大致判斷距離),這也是特斯拉自動駕駛在視覺深度一直為人所詬病的地方。

: 以目前的技術:

: 距離方面,光達的精度比較高

: 平面部分,鏡頭的精度較高,然後鏡頭還可以判斷顏色這個重要資訊

: 以自動駕駛而言,兩者的精度都超過人眼了

: 所以關鍵還是在 AI 等其他方面

無腦特粉才會覺得只靠鏡頭和AI就行

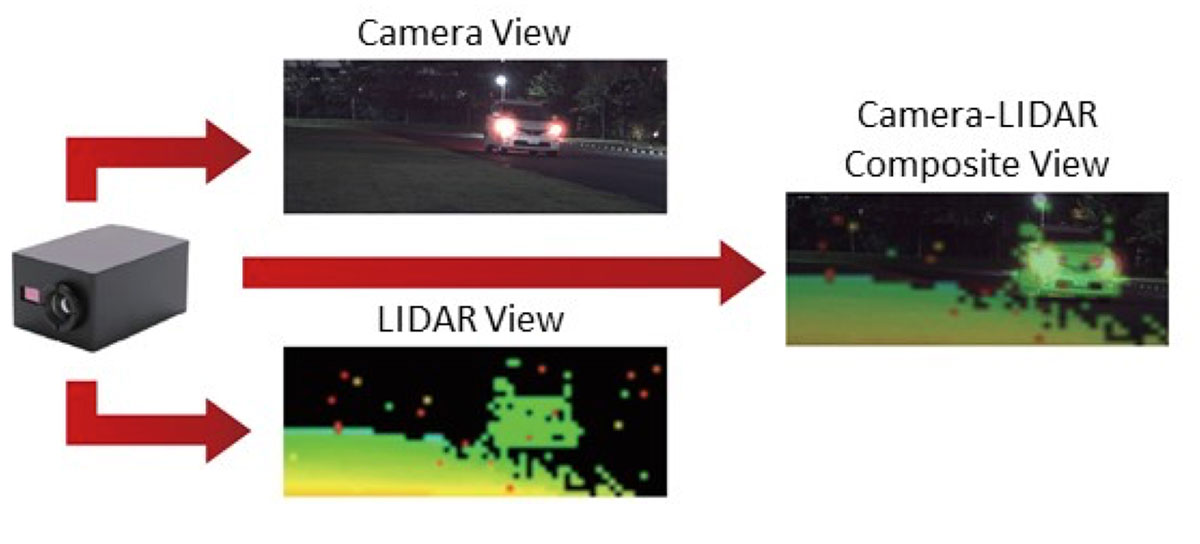

真的在搞自動駕駛的,在研究的是怎麼做多感測器的融合。

https://global.kyocera.com/ces/img/sensing-technology/sec11_img03.jpg

像是直接將光達和攝影機做成同一個感測器,就是其中一個方向。

像是直接將光達和攝影機做成同一個感測器,就是其中一個方向。

: ※ 引述《airforce1101 (我不宅)》之銘言:

: : 影像、雷達、光達不太一樣,我把影像與雷達、光達拆成兩類好了,影像對於訊號處理來

: : 說屬於二維陣列,但是雷達與光達可以帶回三維的目標資訊,雷達就是低頻段的光,因頻

: : 率特性不同,所以適用場景不同,光達的脈衝時間很短,所以較於雷達相比,對於相同目

: : 標,可以帶回更高精度的資訊。

: : 光達的領域上有關延展性目標,可以參考K. Granstrom, M. Baum, and S. Reuter 所著

: : 的這篇文章 Extended object tracking: Introduction, overview, and application.

: : 在AI輔助下,或許環境良好下影像能做到光達能大多數能做的事,但某些判斷影像與光達

: : 先天上的差距還是存在。

: : 其實也好奇,傳感器與影像間的關聯是否讓AI找出並學習其特徵向量,有待高手解答了。

--

亂餵流浪狗的人其實和渣男沒什麼兩樣

一個是讓狗以為自己是有主人的狗,一個是讓人以為感情有了歸宿

但都只是做半套不想完全負責而已

--

: 從最基本的原理來說,光達跟雷達就是用來測距,理論上只有一維的資訊

: 三維的部分是經過一些設計、運算後得到的

: 反而鏡頭得到的一開始就是二維資訊,然後可以經過運算得到三維的資訊,

這邊看完,我的感想只有“供三小?”

雷達與光達在原理上是利用掃描的方式,取得距離與向量,本質上資料的維度就是大於二維了。

是什麼時候變一維的?如果要這麼瞎扯,那鏡頭裡的CMOS一次也只能讀一個cell的資料,

一樣得要逐個掃描才能得到二維影像(這個就是所謂的果凍效應的成因),

照你的說法,鏡頭不也一樣是一維的?

: 特斯拉更進一步從中取得四維資訊(多的那維是時間軌跡預測)

這邊也不知道在供三小

在半個世紀前,雷達後處理技術就已經發展出利用比對前後時間目標的變化,預測目標未來位置,

並且持續追蹤的技術。甚至還有類似合成孔徑雷達(SAR)那種利用時間與位移積分,

利用二維掃描形成3維雷達影像的技術。

而利用都卜勒濾波技術,甚至不需要比對前後時間的資料,就能直接得到目標的速度,

在半個世紀前,雷達就能直接利用都卜勒測速,外插推估目標的未來位置。

但也沒人講雷達是四維資料的探測器。

而特斯拉的前鏡頭並沒有構成立體視覺,就算加上時間預測,也只能構成2.5D,

(三個定焦鏡只能利用影像模糊的程度大致判斷距離),這也是特斯拉自動駕駛在視覺深度一直為人所詬病的地方。

: 以目前的技術:

: 距離方面,光達的精度比較高

: 平面部分,鏡頭的精度較高,然後鏡頭還可以判斷顏色這個重要資訊

: 以自動駕駛而言,兩者的精度都超過人眼了

: 所以關鍵還是在 AI 等其他方面

無腦特粉才會覺得只靠鏡頭和AI就行

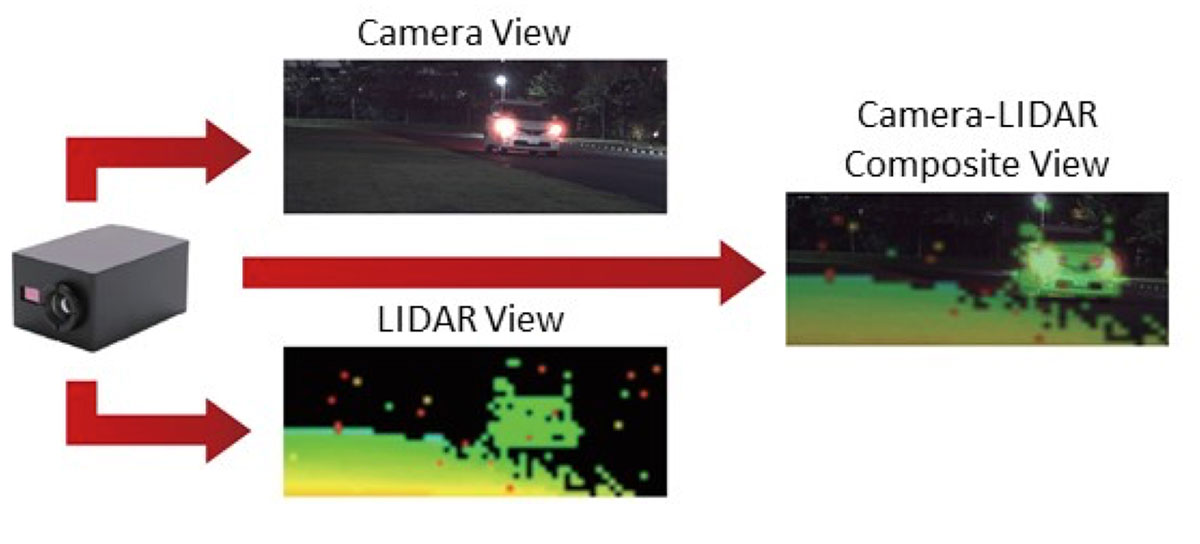

真的在搞自動駕駛的,在研究的是怎麼做多感測器的融合。

https://global.kyocera.com/ces/img/sensing-technology/sec11_img03.jpg

: ※ 引述《airforce1101 (我不宅)》之銘言:

: : 影像、雷達、光達不太一樣,我把影像與雷達、光達拆成兩類好了,影像對於訊號處理來

: : 說屬於二維陣列,但是雷達與光達可以帶回三維的目標資訊,雷達就是低頻段的光,因頻

: : 率特性不同,所以適用場景不同,光達的脈衝時間很短,所以較於雷達相比,對於相同目

: : 標,可以帶回更高精度的資訊。

: : 光達的領域上有關延展性目標,可以參考K. Granstrom, M. Baum, and S. Reuter 所著

: : 的這篇文章 Extended object tracking: Introduction, overview, and application.

: : 在AI輔助下,或許環境良好下影像能做到光達能大多數能做的事,但某些判斷影像與光達

: : 先天上的差距還是存在。

: : 其實也好奇,傳感器與影像間的關聯是否讓AI找出並學習其特徵向量,有待高手解答了。

--

亂餵流浪狗的人其實和渣男沒什麼兩樣

一個是讓狗以為自己是有主人的狗,一個是讓人以為感情有了歸宿

但都只是做半套不想完全負責而已

--

All Comments